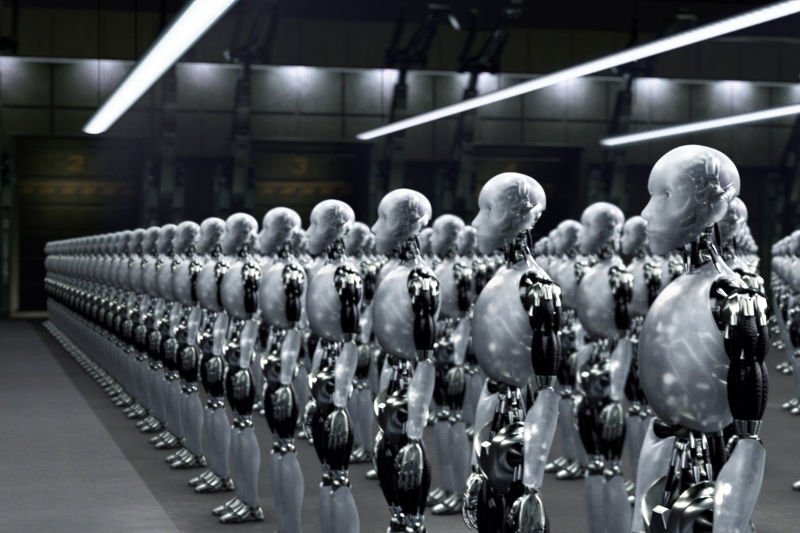

Gdzie znaleźć można najbardziej skomplikowaną sieć na świecie? Odpowiedź znaleźć można w naszych głowach. Chodzi o ludzki mózg. Technologia wciąż nie może się z nim równać. Jednak Sztuczna Inteligencja (SI) to już nie tylko domena filmów i książek science fiction. Jest wszędzie wokół nas. Systemy znaleźć można w smartfonach, samochodach czy na giełdzie. Niektórzy martwią się, że sztuczna inteligencja będzie odpowiedzialna za zagładę ludzkości.

REKLAMA

To jednak przykłady tzw. wąskiej sztucznej inteligencji. Oprogramowanie stworzone do gry w szachy nie będzie umiało zagrać w pokera. Prawdziwa, szeroka sztuczna inteligencja, która miałaby przewyższyć swoimi możliwościami człowieka przez jednych uważana jest za zbawienie, a przez innych za śmiertelne niebezpieczeństwo. – Jedno jest pewne: na zawsze zmieni losy ludzkości – usłyszeć można było na specjalnie przygotowanym filmie tłumaczącym gościom Davos koncept sztucznej inteligencji.

Podczas panelu poświęconego sztucznej inteligencji na Światowym Forum Ekonomicznym specjaliści ze świata nowoczesnych technologii debatowali na temat stanu, w jakim sztuczna inteligencja znajduje się obecnie. Rozmawiali także o jej potencjalnych plusach i minusach, możliwościach wykorzystania w najbliższej przyszłości o tym, co na temat SI powinniśmy wiedzieć, by odpowiednio z niej korzystać.

SI w nauce

– 2015 był przełomowym rokiem pod względem prac nad sztuczną inteligencją – powiedział profesor Andrew W. Moore, dziekan Wydziału Informatyki na Uniwersytecie Carnegie Mellon. Jest ekspertem w dziedzinach uczenia maszynowego, robotyki, sztucznej inteligencji i obliczeń z wykorzystaniem wielkich baz danych. Czemu poprzedni rok był jego zdaniem przełomowy? – Narzędzia do poważnych badań uczenia maszynowego zostały udostępnione naukowcom – mówił.

– 2015 był przełomowym rokiem pod względem prac nad sztuczną inteligencją – powiedział profesor Andrew W. Moore, dziekan Wydziału Informatyki na Uniwersytecie Carnegie Mellon. Jest ekspertem w dziedzinach uczenia maszynowego, robotyki, sztucznej inteligencji i obliczeń z wykorzystaniem wielkich baz danych. Czemu poprzedni rok był jego zdaniem przełomowy? – Narzędzia do poważnych badań uczenia maszynowego zostały udostępnione naukowcom – mówił.

Zdaniem Moore'a wiele osób widzi obecnie potencjał w sztucznej inteligencji. Pociąga ich granica, którą można przekroczyć. Dlatego niektórzy mają odchodzić z korporacji i zakładać własne startupy technologiczne.

Profesor stwierdzał, że technologia zaczyna wchodzić w obszary, w których wcześniej nie miała racji bytu. – Systemy zaczynają rozpoznawać stany emocjonalne. Kiedyś były dobre wyłącznie do zadań niewymagających jakichkolwiek emocji: jak na przykład gry w szachy. Teraz mogą pomagać na przykład w terapii dzieci z autyzmem – tłumaczył Moore.

Sztuczna inteligencja coraz częściej sprawdza się również wśród pracowników biurowych. – Systemy czytają dokumenty prawne. Obecnie znaleźć można zastosowanie takich technologii w biznesplanach. Możemy zastanawiać się, jak pozbyć się nudnych elementów pracy w biurze, niekoniecznie tego, jak pozbyć się pracowników w ogóle – mówił profesor Andrew Moore.

Prawdziwy, wirtualny asystent

Umiejętność czytania przez sztuczną inteligencję za bardzo ważną uznał również profesor Stuart J. Russell, ekspert w sprawach informatyki, inżynierii, neurochirurgii, a także autor wielu książek na temat sztucznej inteligencji. – Jeśli system będzie w stanie przeczytać jeden dokument, to będzie mógł przeczytać kolejny, i kolejny, i kolejny. Będzie mógł przeczytać o wiele więcej niż człowiek będzie kiedykolwiek w stanie – mówił.

Umiejętność czytania przez sztuczną inteligencję za bardzo ważną uznał również profesor Stuart J. Russell, ekspert w sprawach informatyki, inżynierii, neurochirurgii, a także autor wielu książek na temat sztucznej inteligencji. – Jeśli system będzie w stanie przeczytać jeden dokument, to będzie mógł przeczytać kolejny, i kolejny, i kolejny. Będzie mógł przeczytać o wiele więcej niż człowiek będzie kiedykolwiek w stanie – mówił.

Na nic jednak będzie sama umiejętność czytania, jeśli system nie będzie rozumiał tego, co czyta i tego, co się do niego mówi. – Siri jest urocza, ale nie rozumie nic z tego, co do niej mówimy. Może jedynie przejrzeć za nas internet i poszukać tam odpowiedzi. Gdyby miała wiedzę, byłaby idealnym osobistym asystentem. Wielu z prezesów obecnych w Davos jest bezużytecznych bez swoich ludzkich asystentów – mówił Russell i zaznaczał, że posiadanie rozumnego asystenta przez cały czas w kieszeni otwiera przed nami zupełnie nowe możliwości.

Skomercjalizować inteligencję

Doktor Ya-Qin Zhang, dyrektor ds. nowego biznesu w Baidu, chińskim gigancie na rynku wyszukiwarek internetowych, zaznaczał, że sztuczna inteligencja pełni bardzo ważną rolę w każdym z produktów, nad jakimi pracuje obecnie firma: od rozpoznawania głosu, przez samą wyszukiwarkę, po platformę dla reklamodawców. – W ciągu ostatnich kilku lat SI przeszło do mainstreamu – mówił. – Małe firmy i startupy mogą wykorzystywać sztuczną inteligencję do swoich potrzeb. Sztuczna inteligencja potrzebuje wielkiej mocy przerobowej i ogromnej ilości danych, a te mogą zapewnić sobie tylko dobre firmy – mówił, zachęcając niejako do współpracy mniejszych graczy z gigantami.

Doktor Ya-Qin Zhang, dyrektor ds. nowego biznesu w Baidu, chińskim gigancie na rynku wyszukiwarek internetowych, zaznaczał, że sztuczna inteligencja pełni bardzo ważną rolę w każdym z produktów, nad jakimi pracuje obecnie firma: od rozpoznawania głosu, przez samą wyszukiwarkę, po platformę dla reklamodawców. – W ciągu ostatnich kilku lat SI przeszło do mainstreamu – mówił. – Małe firmy i startupy mogą wykorzystywać sztuczną inteligencję do swoich potrzeb. Sztuczna inteligencja potrzebuje wielkiej mocy przerobowej i ogromnej ilości danych, a te mogą zapewnić sobie tylko dobre firmy – mówił, zachęcając niejako do współpracy mniejszych graczy z gigantami.

– Coraz częściej widzimy tę technologię w prawdziwym świecie – mówił z kolei Matthew Grober, wiceprezydent i dyrektor ds. technologicznych firmy Qualcomm. – Samochody pozwalające zdjąć ręce z kierownicy jeżdżą już przecież po naszych drogach – dodawał.

– Jesteśmy jednak wciąż kilka lat przed wejściem autonomicznych samochodów na ulice miast – kontrował profesor Russell. Tłumaczył, że systemy wciąż działają na zasadzie zgodności pewnych zasad i reakcji: jeśli stanie się X to Y. – Są jednak sytuacje, w których nie możemy zastosować się do tych zasad, np. gdy rowerzysta jedzie po złej stronie drogi. Czy samochód powinien zjechać z trasy, zahamować i zaryzykować, że ktoś wjedzie nam w zderzak, czy może potrącić rowerzystę? W końcu nie rozumie, dlaczego ludzie nie lubią być potrącani. Gdyby postanowił oddać nam kontrolę, to może być niebezpiecznie, bo np. sprawdzamy w tym czasie pocztę na telefonie – mówił Russell.

Śmiertelne zagrożenie?

– Dlaczego jednak myślimy o sztucznej inteligencji jako o zagrożeniu dla ludzkości? – pytała panelistów prowadząca spotkanie Connyoung Jennifer Moon z koreańskiej telewizji Arirang. Na pytanie obrazowo zaczął odpowiadać profesor Russell. Przytoczył on zeszłoroczny przykład DeepMind, projektu wykupionego niedawno przez Google. Firma stworzyła sztuczną inteligencję, bez żadnego wstępnego programowania, która miała za zadanie osiągać jak najlepsze wyniki w starych grach na Atari. – Była jak nowo narodzone dziecko, nie znała koncepcji czasu, przestrzeni. Po pewnym czasie radziła sobie z grami na poziomie przewyższającym ludzi. Jeśli twoje nowo narodzone dziecko się tak zachowuje, to rzeczywiście można się bać – mówił.

– Dlaczego jednak myślimy o sztucznej inteligencji jako o zagrożeniu dla ludzkości? – pytała panelistów prowadząca spotkanie Connyoung Jennifer Moon z koreańskiej telewizji Arirang. Na pytanie obrazowo zaczął odpowiadać profesor Russell. Przytoczył on zeszłoroczny przykład DeepMind, projektu wykupionego niedawno przez Google. Firma stworzyła sztuczną inteligencję, bez żadnego wstępnego programowania, która miała za zadanie osiągać jak najlepsze wyniki w starych grach na Atari. – Była jak nowo narodzone dziecko, nie znała koncepcji czasu, przestrzeni. Po pewnym czasie radziła sobie z grami na poziomie przewyższającym ludzi. Jeśli twoje nowo narodzone dziecko się tak zachowuje, to rzeczywiście można się bać – mówił.

Zaznaczał przy okazji, że w sprawach technologii bardzo trudno jest obliczyć nadejście przełomowego momentu. – Prawo Moore'a, które mówi, że rozwój technologii będzie cyklicznie przyspieszał, nie jest w kwestii sztucznej inteligencji przekonujące. W fizyce nuklearnej było podobnie. Jednego dnia powiedziano, że niemożliwe jest pozyskiwanie energii z atomów, następnego doszło do pierwszej reakcji, a kilka miesięcy później stworzono bombę atomową – zaznaczał Russell.

Jego zdaniem powinniśmy zawczasu przygotować się na potencjalne zagrożenia i problemy związane ze sztuczną inteligencją. – Posiadanie rzeczy, które są od ciebie mądrzejsze, może być niebezpieczne. Musimy upewnić się, że maszyny będą robić dokładnie to, o co będziemy je prosić. Problem polega na tym, że nie jesteśmy najlepsi w werbalizowaniu zadań i potrzeb. Przypomnijmy sobie chociażby mit o królu Midasie – kontynuował Russell.

Profesor Moore zaznaczał jednak, że do badań nad sztuczną inteligencją przyciąga wszystkich właśnie chęć czynienia dobra. – Moi studenci są zafascynowani wizją, w której dzięki algorytmom można ratować życie setek ludzi – tłumaczył. – Musimy być uważni – dodawał Matthew Grober z Qualcomm. – Jest w tym wiele pozytywnego potencjału: bezpieczniejsze samochody, wygodniejsze narzędzia medyczne, poprawa bezpieczeństwa w sieci. Najważniejszą kwestią jest zadbanie o to, by wszystko funkcjonowało w zaprojektowany wcześniej sposób – kończył.

Napisz do autora: adam.turek@innpoland.pl